Dès lors que le contexte actuel précipite le passage à la banque digitale, il est particulièrement intéressant de se pencher sur la question de l’usage des algorithmes utilisés pour autoriser des opérations, comme les paiements, ou pour prendre des décisions, par exemple d’octroi de crédit. Dans une récente publication, l’INSEAD pose à ce propos une question assez essentielle : comment apaiser les clients que vos algorithmes ont rejetés ?

Chacun est à même de l’expérimenter, rien n’est plus frustrant, en ligne, qu’un refus incompréhensible ou le rejet d’un paiement sans explication. Ce n’est pas seulement frustrant. C’est également souvent angoissant. Pourtant, à l’heure où l’on ne parle que d’optimisation de l’expérience client, il est frappant de constater à quel point les banques se soucient assez peu de cette réalité. A quel point s’impose un nouvel ordre digital, soumis à la logique frustre des machines, qui n’est pas sans certains aspects kafkaïens.

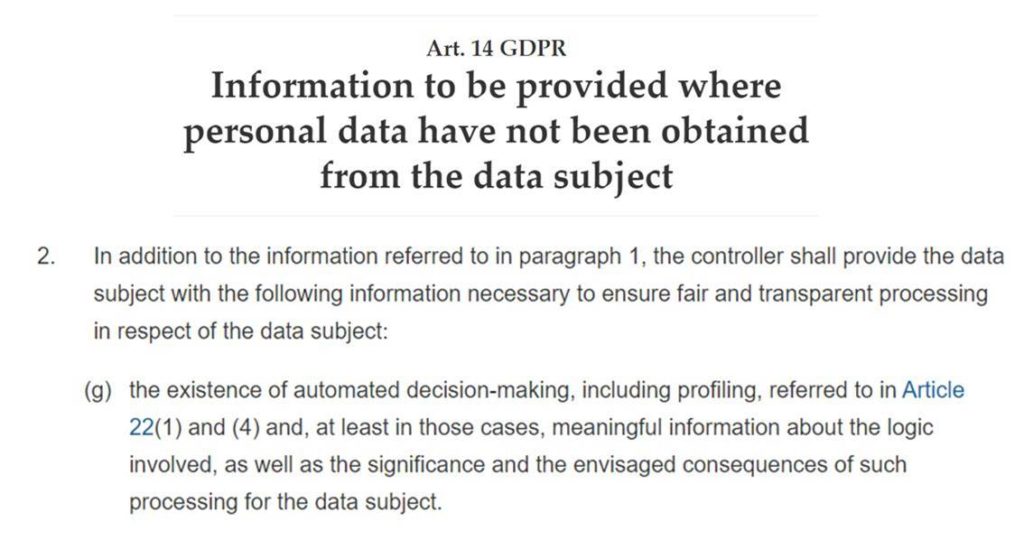

Pourtant, dans beaucoup de cas, informer ne coûterait rien. Les rejets tiennent souvent à peu de choses, une donnée manquante, une disposition qu’il suffirait d’expliciter – tout en indiquant comment lever l’obstacle. A suivre les dispositions européennes en matière de protection de données, le RGPD – malheureusement écrites dans une langue qu’on dirait être celle d’une machine ! – cela semble même obligatoire.

La publication de l’INSEAD livre les résultats de tests menés pour corriger cet état de fait et en arrive à la conclusion peu contestable qu’il vaut mieux délivrer de l’information que pas du tout. Certes ! Mais pourquoi est-ce rarement le cas ?

Pourquoi ne pas rendre les algorithmes transparents ? Cela est à même de soulever des questions éthiques. S’agit-il à travers eux de forcer les clients, de les piéger à leur insu ? De quel droit ? Il faudrait interroger sous cet angle les approches de type « Nudge ». Mais, de manière générale, cela est très loin des préoccupations courantes. Nous qui plaidons pour davantage de transparence en matière de scoring de crédit plutôt qu’en boite noire, nous voyons la plupart du temps (en France) la proposition être balayée d’un revers de manche au prétexte que cela favoriserait une fraude massive (ce qui témoigne de l’image exacte que l’on a des clients !).

Tout tient en fait à un problème d’organisation et de fonctionnement en silos. Ceux qui mettent en place les algorithmes ont souvent peu d’idées quant à leurs usages réels et ne les traduisent pas en un langage naturel qui serait facilement accessible à ceux qui les utilisent. De sorte que la plupart du temps, les commerciaux ne savent pas davantage que leurs clients pourquoi telle opération est rejetée. Faute d’une direction d’ensemble suffisamment exigeante, on en arrive à des algorithmes quasi autonomes, avec lesquels il faut apprendre à vivre.

Bien sûr, le recours à l’IA et le développement de bots – dont on peut souligner qu’ils répondent souvent à des objectifs assez vagues – pourraient particulièrement servir à corriger cet état de fait, en optimisant pour le coup réellement l’expérience client. Mais cela repose la question du niveau de conduite de la coordination projet.

Pour prendre un exemple, nous avons recours aux SMS d’alerte que nous adresse notre banque quant à la gestion de plusieurs comptes familiaux. Eh bien, les alertes n’indiquent pas à quel compte en particulier elles se réfèrent (sinon peut-être à travers un code obscur non explicité et qui nous échappe), ce qui est peut être source d’interrogations parfois assez angoissantes. La question serait ainsi de savoir comment, en 2020, une banque peut maintenir un tel niveau de service digital. Nous n’avons pas la réponse. Mais nous avons une idée précise de ce qui est à même de bloquer toute innovation conséquente dans cet établissement !

Score Advisor